A lo largo de la carrera de físicas hay una serie de conceptos o modelos que se estudian una y otra vez desde diferentes aspectos. En la UCM al menos, dos de los más recurrentes son el oscilador armónico (en formas tan variadas como péndulos, circuitos electrónicos o cristales) y la histéresis (magnética y mecánica,…

A lo largo de la carrera de físicas hay una serie de conceptos o modelos que se estudian una y otra vez desde diferentes aspectos.

A lo largo de la carrera de físicas hay una serie de conceptos o modelos que se estudian una y otra vez desde diferentes aspectos.

En la UCM al menos, dos de los más recurrentes son el oscilador armónico (en formas tan variadas como péndulos, circuitos electrónicos o cristales) y la histéresis (magnética y mecánica, las más queridas entre el alumnado). Esto se debe a que la Naturaleza es recurrente en muchos casos.

Sin embargo, hay tres principios, las tres cabezas del can Cerbero, que no es que se correspondan con muchos procesos físicos, sino que «coartan» y limitan cualquier situación, intercambio, reacción o interacción que se pueda producir en CUALQUIER rama de la física (y la química, y las ingenierías, claro).

¿Estamos hablando de física clásica, relatividad o cuántica de campos? No importa, que los tres protagonistas de esta entrada llegarán para imponer su ley, su criterio, frente a cualquier otra consideración.

Como muchos ya sabrán, me estoy refiriendo a los 3 Principios de la Termodinámica. No he conseguido encontrar la cita, pero creo recordar que un físico de los buenos, un peso pesado, dijo que si tu teoría era bella, tenía muchas posibilidades de ser cierta, pero si contradecía los principios de la termodinámica, era errónea. Así que, en un arranque de vanidad, me lanzo a intentar explicar qué son y qué significan estos tres principios. Y lo más importante: qué consecuencias reales tienen.

La 1º de tres cabezas

El primer principio de la termodinámica es el de conservación de la energía. Esa frase muy conocida que dice «la energía ni se crea ni se destruye; se transforma», que tanto han tergiversado los bufones de las pseudociencias y contactos con el más allá, es la síntesis total de este primer principio. Podemos verlo de una forma algo más precisa diciendo que establece que la variación de energía de un sistema durante cualquier transformación (cambio de volumen, temperatura, interacción entre partículas…) es igual a la cantidad de energía que el sistema intercambia con el entorno, siendo negativa si el sistema le da energía al entorno y positiva si es el entorno el que le cede energía.

En cuanto al «entorno» quiero decir un par de cosas. En termodinámica, cuando se habla del «sistema» y del «entorno» debe quedar claro a qué nos referimos. El sistema se refiere al sistema físico (gas, partículas, recipiente…) que nos interesa estudiar. Ya sea un pistón que presiona un gas o un recipiente aislante con un líquido en su interior; dos partículas que colisionan entre ellas o dos compuestos químicos reaccionando entre ellos, sólo nos interesa su energía y la forma en que evolucionan en el tiempo. Todo lo demás que les rodea, fuera del recipiente que contiene nuestro sistema, o fuera de los límites que lo enmarcan, es lo que llamamos entorno. Y el entorno puede ser el resto del universo (de una manera estricta, lo es), pero no nos interesa su evolución más allá de la forma en que intercambia energía con el sistema. Ya puede explotar una supernova o producirse una explosión nuclear, que en principio, sólo nos interesa qué cantidad de energía y de qué forma, se intercambia con nuestro experimento.

No hay una demostración formal de esta afirmación desde un punto de vista termodinámico, ya que es un principio, es decir, un axioma dado. Eso sí, estos principios se basan en la observación de los fenómenos físicos y no son arbitrarios en ese sentido.

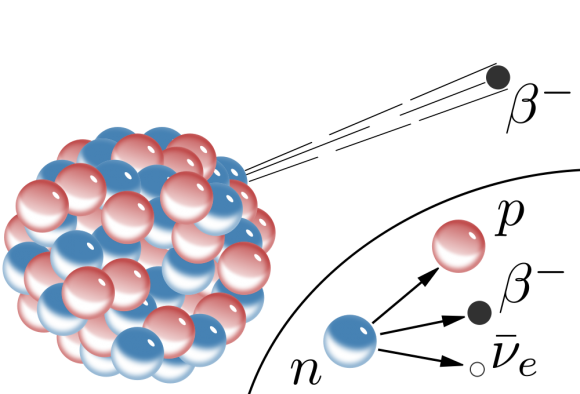

En esta situación, los físicos debían o bien rechazar la conservación de la energía como un principio de la física, o encontrar «la fuga» de la energía sobrante. En este caso, hablo de la desintegración beta en la que un neutrón se desintegra en un electrón (o también un protón se desintegra en un positrón o anti-electrón). Resulta que esta desintegración tiene una falta de energía, ya que la energía inicial es mayor que la final. Así que Wolfgang Pauli predijo que debía existir una partícula con ciertas características y muy difícil de detectar que se llevase la energía que faltaba. Así fue como se postuló por primera vez el neutrino (más concretamente, el anti-neutrino).

Por otro lado, la energía tiene una correspondencia con la masa, siendo dos aspectos de la misma cosa. Esto lo sabemos gracias a la relatividad de Einstein, de forma que la masa puede convertirse en energía y viceversa. Lo cual sólo es un añadido al principio de la termodinámica que, cuando se formuló, no tenía en cuenta efectos relativistas. Podemos decir, por tanto, que la energía-masa se conserva.

Ahora viene lo bueno. Si uno navega por Internet podrá descubrir que este principio ha sido completamente destruido desde hace mucho tiempo. Esto es porque puede encontrar miles de vídeos en Youtube, páginas y blogs en los que mediante sencillos montajes con imanes, cables y espiras se obtienen máquinas de movimiento que generan energía de la nada.

Son los llamados móviles perpetuos de primera especie, esto es, máquinas que son capaces de generar energía de la nada con sólo ponerlas en funcionamiento, pero que no han podido comercializarse debido a las grandes compañías petroleras y de energía que no quieren ver arruinado su negocio. Bien, animo a todo curioso que intente fabricar estos modelos, el que quiera, que descubrirá que el suyo no funciona. Resulta que son todos fraudes.

Uno puede ver múltiples argumentos en los blogs, comentando que está pensando hacerlo más grande para que funcione, que al ser pequeño no lo hace, etc. El resultado será que nunca funcionarán, o si funcionan, que tienen algún truco (normalmente un motorcito con su pila).

Tras ver la primera, veamos quién es la segunda cabeza del monstruo.

Enemiga de la eficiencia

En este apartado hablaremos del segundo principio de la termodinámica. Hemos visto que el primer principio establece la imposibilidad de que una máquina produzca energía (o la destruya), de manera que sólo permite que la energía se transforme. Pero, ¿puede transformarse de la manera que quiera? Ahí entra en juego el segundo principio, que limita la forma en que la energía se transforma. Algo que resulta muy útil para el diseño de máquinas eficientes (en el sentido que aprovechan bien la energía que se les proporciona para realizar un trabajo).

Esta segunda ley o principio ha sido un limitante muy grande en el desarrollo de la tecnología, motivo por el que ha sido desafiada durante muchísimos años con el fin de conseguir máquinas que realizasen trabajo a partir del calor recibido del entorno. Porque el segundo principio permite que todo el trabajo que se realiza contra un cuerpo se convierta en calor (por ejemplo, un trozo de metal al que friccionamos constantemente, termina aumentando su temperatura), pero impide que el calor se transforme íntegramente en trabajo. Definiendo esto, hay dos formulaciones equivalentes de este principio debidas a Lord Kelvin y a Clausius. El primero postuló el segundo principio como sigue:

[cite size=»small»]Una transformación cuyo resultado final sea únicamente la transformación de trabajo del calor extraído de una fuente, estando todo a la misma temperatura, es imposible.[/cite]

Comentemos el significado de estas dos líneas. Si tenemos dos objetos, uno de ellos una máquina y el otro lo llamamos fuente de calor, para conseguir que la máquina funcione, la fuente debe estar a una temperatura superior. Como ejemplo sencillo tendríamos la máquina de vapor: la caldera está a una temperatura mayor que el agua que hay en la máquina, de forma que consigue que esta evapore y mueva unas turbinas al salir de los conductos debido al aumento de presión que se produce al convertir en vapor el agua. Lo que dice el enunciado de Kelvin es que si la caldera estuviese a la misma temperatura que el resto de la máquina (incluyendo el agua en «resto de la máquina»), no conseguiremos obtener trabajo, ya que no conseguiremos evaporar el agua.

Esto es sencillo si nos vamos a la física a nivel molecular o atómico. La temperatura de un cuerpo se puede ver como un índice que nos dice cómo de rápido se mueven las partículas de ese cuerpo. Es decir, nos ida una idea de cuánto vibran sus partículas: cuanto más temperatura, mayor será ese movimiento o vibración. Por tanto, imaginemos que ponemos dos cuerpos juntos, que están a la misma temperatura. Cuando choquen las partículas en la frontera entre los cuerpos, de media no se van a transferir energía, ya que tienen ambos el mismo grado de velocidad o vibración.

Sin embargo, si uno de ellos está a gran temperatura respecto al otro, en cada choque, las partículas del primero se frenarán un poco mientras que las del segundo se acelerarán. Como cuando golpeamos una bola de billar con otra a gran velocidad. Eso es la transferencia de energía que llamamos conducción. Así que es fácil ver que si ambos cuerpos están a la misma temperatura, no se transferirá energía de uno a otro, por lo que no podremos hacer trabajo.

La forma en que describió Clausius este principio es como sigue:

[cite size=»small»]Una transformación cuyo único resultado final sea la transferencia de calor desde un cuerpo a una temperatura dada a otro cuerpo a una temperatura superior a la anterior es imposible.[/cite]

Vemos ahora el significado de esto. En primer lugar, si nos pasamos de nuevo a una visión microscópica, vemos que si un cuerpo está a temperatura inferior a otro no podrá pasarle energía por lo que hemos visto de las partículas chocando y transfiriéndose energía. Por tanto, el enunciado tiene sentido. En segundo lugar, comentar que ambos enunciados son equivalentes, pero no lo demostraremos (si alguien está interesado, ver Enrico Fermi, p. 30, «Thermodynamics»).

En conclusión, el segundo principio nos dice cómo se puede transformar la energía, y descarta la posibilidad de que se pueda construir una máquina que realice un trabajo sin recibir energía de un foco a mayor temperatura (a nivel más prosaico: no puede funcionar una máquina sin recibir constantemente energía, ya sea por electricidad, combustible…).

La entropía, reversibilidad y la muerte térmica del Universo

La tercera cabeza del monstruo, según hemos ido construyendo el artículo, resultaría ser el tercer principio que sería el siguiente:

[cite size=»small»]Al llegar al cero absoluto, 0 K, cualquier proceso de un sistema físico se detiene.

Al llegar al cero absoluto la entropía alcanza un valor mínimo constante.[author] (Wikipedia) [/author][/cite]

Es decir, en el cero absoluto no habría vibración de átomos, ni reacciones químicas ni emisión de energía… Pero la utilidad de este principio es a un nivel matemático en el sentido de que permite establecer un origen para eso llamado entropía. Así que la verdadera cabeza del monstruo es más concretamente la entropía, una propiedad de los sistemas físicos que vamos a intentar explicar en los siguientes párrafos.

Para empezar hay que explicar primero qué es una transformación reversible y una irreversible.

La primera sería una transformación de un sistema desde un estado a otro pasando siempre por estados intermedios de equilibrio.

¿Qué significa esto?

Pues que si hacemos que un gas, por ejemplo, se expanda muy lentamente, de manera que no se produzcan turbulencias ni cosas parecidas, hasta un estado final en el que ocupa el doble de lo que ocupaba al principio, podemos conseguir revertir el sistema a su estado inicial de manera que el sistema ni ha ganado ni ha perdido energía.

Sobra decir que en el mundo real no existen transformaciones reversibles: el rozamiento, el hecho de que no tenemos recipientes completamente aislados y siempre hay fugas de gas, calor, etc., hacen que sea imposible tal cosa.

La entropía es una magnitud física que, hablando pronto y mal, da idea del desorden del sistema. Un sistema ordenado, como una estructura cristalina, tendría menos entropía que en mismo cristal pero fundido, hecho líquido. En realidad, es más sutil que eso, y lo veremos un poco más adelante.

El caso es que la ecuación para la entropía es una desigualdad. La variación de entropía de un sistema es mayor o igual a la variación de calor partido por la temperatura. Resulta que cuando el sistema está aislado del entorno, la variación (o intercambio) de calor es cero, como es lógico.

Por tanto, operando la ecuación que quedaría S(B)-S(A)>=0 obtenemos lo siguiente: S(B)>=S(A). Resumiendo esto, S(B) sería la entropía del sistema al final de una transformación cuando alcanza el estado B, y S(A) es la entropía del sistema al principio, antes de sufrir el cambio de estado. Por tanto, la entropía de un sistema aislado siempre aumenta o se mantiene constante.

Este resultado es algo confuso quizá, pero establece el hecho de que un sistema físico (un gas, por ejemplo) siempre va a ver como su entropía, que recordemos indicaba el «desorden» del sistema, se mantiene constante o aumenta. Se mantendrá constante cuando el proceso que cambia el sistema (aumento de volumen, por ejemplo) se produzca de manera muy lenta y muy suave (lo que se llamaría proceso reversible) y aumentará cuando el proceso sea más «violento» o repentino. En este caso, el proceso sería irreversible.

¿Y este follón, que sentido tiene? Bueno, descubrámoslo aplicándolo al Universo entero. El Universo, si lo definimos como «todo lo que es», es un sistema cerrado. Esto es porque como no existe nada más, aparte del Universo, no hay nada con lo que intercambiar energía. Si hubiese algo más aparte del Universo, automáticamente nuestro Universo incluiría eso nuevo (ya que Universo se define como todo lo que existe), y volveríamos al caso anterior. Así que estaríamos en el caso que acabamos de ver para la entropía: S(B) es mayor o igual a S(A). Así que si el Universo sólo contuviese procesos de los reversibles, que son suaves y lentos, podría mantener constante su entropía, o nivel de desorden.

Sin embargo, en el Universo ocurren cataclismos y reacciones que no son, desde luego, procesos suaves y lentos. Explosiones de supernova, agujeros negros absorbiendo materia, choques galácticos… en todos estos procesos la entropía del Universo aumenta llegando cada vez más a un estado estable de máxima entropía. Esto significa el mayor nivel de desorden posible, donde la energía está en su forma más degradada. Es la llamada muerte térmica del Universo.

¿Y qué limitación impone esto a la física? Pues en cierto modo, establece hacia donde apunta la flecha del tiempo. Expliquemos esto, a ver si consigo hacerlo entendible: en cierto sentido, la física es reversible. Es decir, sus ecuaciones son simétricas respecto al tiempo de tal forma que no importa en qué «dirección» temporal nos movamos, físicamente serían válidas.

Por poner un ejemplo, si tenemos un billar y una bola blanca que golpea a las demás cuando están colocadas en un triángulo, sabemos que el «sentido correcto» sería en el que las bolas terminan desperdigadas por el tapete. Pero físicamente (al menos, según la física clásica), sería posible también una situación inversa en la que las bolas rebotan en sentido contrario hasta que llegan a situarse juntas en el tapete y la blanca en su sitio. El único motivo por el que el sistema no sería reversible es debido a la entropía. Antes comentábamos que indica el «grado de desorden» y ha llegado el momento de matizar esto.

Tenemos que imaginar un mapa, en el que hay regiones distintas. Estas regiones serían equivalentes a estados del sistema: por ejemplo, una región donde todas las bolas estarían colocadas en el triángulo.

Cada punto de esta región representaría una posible configuración: por ejemplo, un punto sería el que representase las bolas colocadas de forma alterna y por orden numérico (color sólido, franja, color sólido, franja…); otro punto el que fuese como el anterior, pero la bola negra estuviese en otra posición distinta del centro.

Ambos puntos representarían la situación de máximo orden en la mesa de billar, pero por otra parte, a nivel de las bolas en concreto (en un gas hablaríamos de nivel microscópico) serían distintos.

Otra región sería aquella que representase todas las bolas desperdigadas por el tapete de una forma determinada: una bola cerca de una esquina, dos en el centro y otras agrupadas en el otro extremo, por ejemplo. Esa región contendría puntos que tendrían la misma posición de las bolas, pero cada punto representaría una combinación distinta de las bolas.

Bien, pues la entropía representaría en realidad, la probabilidad de estar en una de las regiones del mapa que hemos imaginado. Por tanto, cuantas más combinaciones posibles, cuantos más puntos en definitiva, tenga cada región, más probabilidad tendré, consecuentemente, más entropía. Esta idea se la debemos a Boltzman y es de gran utilidad. Hay que darse cuenta que, en general, para estados ordenados, tenemos menos puntos en la región, por lo tanto, tenemos menos probabilidad, por lo tanto, tenemos menos entropía. Y en sistemas desordenados, hay más variabilidad, más puntos, más probabilidad, más entropía. Tenemos ya una representación de la entropía en función de algo más entendible y no como una propiedad extraña de los sistemas que estudiemos.

Así que la entropía nos da una idea de cómo va a evolucionar un sistema físico: cuantos más puntos tenga una región, más probable es que el sistema termine en alguno de sus estados, así que la imagen que hemos usado del billar y las bolas será muy simétrica respecto al tiempo, pero la entropía nos indica que lo más probable es que termine muy desordenado según vamos jugando (y somos suficientemente malos como para no meter ninguna bola en su agujero, claro).

Lo cierto es que no supone un limitante tan grande como las anteriores «cabezas» que hemos visto, ya que el hecho de que un estado sea poco probable, no significa que no sea posible, pero es cierto que da mucha información a la hora de predecir un estado físico, qué ocurrirá y que no es probable que ocurra.

Conclusión

Los principios de la termodinámica son muy importantes en física, como hemos podido comprobar, y también tienen muchas implicaciones. En cualquier rama de la física más avanzada se tiene en cuenta estos principios de manera directa o indirecta, pero siempre están presentes. Por eso decidí hacer esta entrada. Espero haber conseguido acercar un poco las ideas de la termodinámica que tan importantes son y tan poco se han divulgado (que yo sepa), aunque me temo que algún párrafo no haya quedado todo lo claro que me hubiese gustado. No ha sido tarea fácil, pero confío en que habrá sido suficiente, al menos, para despertar el interés del público en la termodinámica. Personalmente, creo que la termodinámica es de las ramas más importantes de la física por su carácter tan general, precisamente. No en vano, es de las asignaturas más complejas y con más implicaciones de las que he tenido que estudiar, siendo difícil precisamente por esto. Sin embargo, el asombro que se siente al descubrir y entender sus principios es algo que quería compartir, así que espero haberlo conseguido

—————————-

Este artículo participa en los Premios Nikola Tesla de divulgación científica y nos lo envía Victor Hevia, Físico aspirante a divulgador en Hablando de Ciencia, ex-científico del Hormiguero, futuro investigador del INTA y procastinador patológico con más ideas en la cabeza que en la práctica. Podéis seguirlo en el tuiter @GdeGalleta

Bibliografía

Aunque he consultado varios sitios, la bibliografía básica tanto para escribir el artículo como para estudiar estos temas, ha sido la siguiente:

- «Thermodynamics» Enrico Fermi

- «Curso de Termodinámica», José Aguilar

Edición: Según comentaron en Amazings (Purnelio fue el primero si no me equivoco) cuando publicaron esta entrada, la cita se debe a Sir Arthur Eddington y es bastante más bella que como yo la he expresado:

“The law that entropy always increases holds, I think, the supreme position among the laws of Nature. If someone points out to you that your pet theory of the universe is in disagreement with Maxwell’s equations — then so much the worse for Maxwell’s equations. If it is found to be contradicted by observation — well, these experimentalists do bungle things sometimes. But if your theory is found to be against the second law of thermodynamics I can give you no hope; there is nothing for it but to collapse in deepest humiliation.»

Me gustaría agradecer también a César de Experientia Docet sus aportaciones para mejorar la precisión de este artículo. El que sea divulgativo no tiene porqué significar que se renuncie a la rigurosidad.